Vulnerability of Appearance-based Gaze Estimation

2021预印本

Mingjie Xu1 Haofei Wang2 Yunfei Liu1 Feng Lu1, 2, *

1State Key Laboratory of VR Technology and Systems, School of CSE, Beihang University

2Peng Cheng Laboratory, Shenzhen, China

评价:基于外观的凝视估计的脆弱性

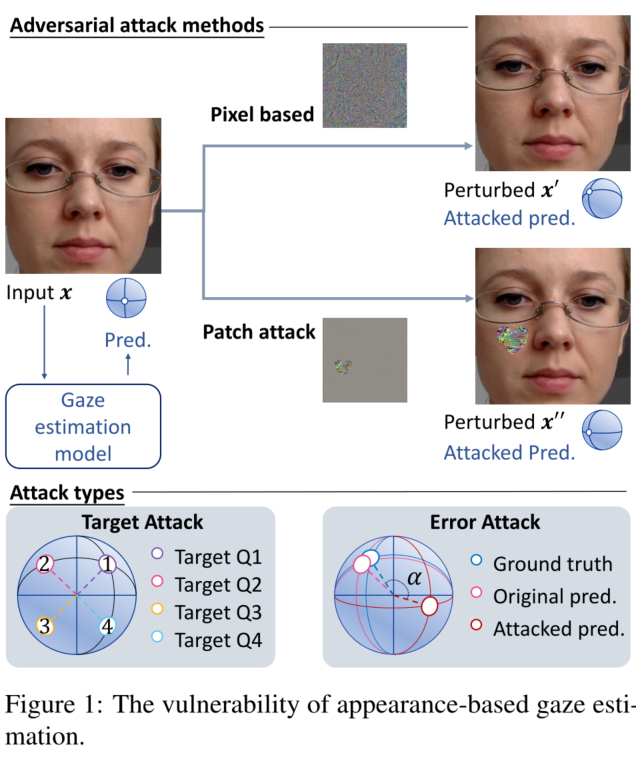

针对问题:利用噪声对原始图像进行干扰会混淆凝视估计模型,基于机器学习的方法存在脆弱性。

本文的目的:尽管扰动后的图像在视觉上与原始图像相似,但凝视估计模型输出的凝视方向是错误的。本文研究了基于外观的注视估计的脆弱性。

从多个方面系统地描述了该漏洞的特性。

- 基于像素的对抗攻击pixel-based adversarial attack、

- 基于补丁的对抗攻击patch-based adversarial attack

- 防御策略 defense strategy等。

实现的方法:通过在原始输入中加入对抗性扰动,研究了是否有可能改变预测的注视方向,甚至输出一个特定的注视方向。

refer

眼神凝视是人类交流的重要渠道之一。它表示人眼分型[17,24]、认证[13,19]、显著性预测[31]、目标检测[7]等过程中感兴趣的区域 the region of interest during eye typing

[17,24], authentication [13,19], saliency prediction [31],

object detection 。

观察到,当只攻击“鼻子”或“嘴”时,系统会产生很大的角度误差。图4(b)和图4(c)显示,发作后注意区域仅为“鼻子”或“嘴”。如果同时攻击“鼻子”和“嘴”,则角度误差会大大降低,攻击后注意区域也会同时转移到“鼻子”和“嘴”。

但是这个角误差还是比通过攻击其他部分来完成那个大。注意,不是所有的注意力区域都在“眼睛”上,这导致了这样的结果。如果我们同时攻击“眼睛”和“鼻子”,或者同时攻击“眼睛”和“嘴巴”,平均角度误差就会比只攻击“鼻子”和“嘴巴”低得多。在这种情况下,注意力区域在“眼睛”和其他部分。

Yiwei Bao, Yihua Cheng, Y unfei Liu, and Feng Lu. Adaptive

feature fusion network for gaze tracking in mobile tablets. In

25th International Conference on Pattern Recognition (ICPR),

2020.

Yihua Cheng, Shiyao Huang, Fei Wang, Chen Qian, and Feng

Lu. A coarse-to-fine adaptive network for appearance-based

gaze estimation. InProceedings of the AAAI Conference on

Artificial Intelligence, volume 34, pages 10623–10630, 2020.

Seonwook Park, Shalini De Mello, Pavlo Molchanov, Umar

Iqbal, Otmar Hilliges, and Jan Kautz. Few-shot adaptive gaze

estimation. InProceedings of the IEEE/CVF International

Conference on Computer Vision, pages 9368–9377, 2019.

Tobias Fischer, Hyung Jin Chang, and Yiannis Demiris. RT-

GENE: Real-Time Eye Gaze Estimation in Natural Environ-

ments. InEuropean Conference on Computer Vision, pages

339–357, September 2018.

Yihua Cheng, Xucong Zhang, Feng Lu, and Y oichi Sato.

Gaze estimation by exploring two-eye asymmetry.IEEE

Transactions on Image Processing, 29:5259–5272, 2020.